展博科研(展博科研属于长沙展博开创生物科技有限公司旗下的科研服务简称)最近推出新的医学发文热点---SHAP可解释性分析

1.方法简介

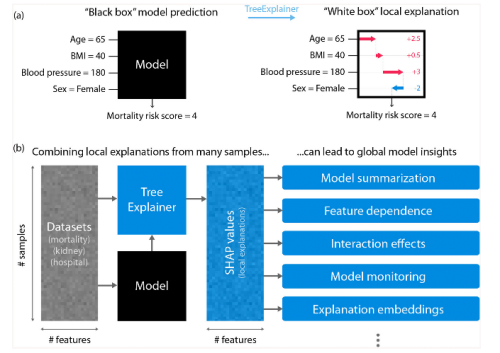

SHAP是一种基于博弈论中经典沙普利值的模型解释方法,旨在为任何机器学习模型的预测提供一致且可解释的特征重要性度量。其核心思想是将每个特征视为一个“合作者”,通过计算该特征在所有可能特征子集中对模型输出的平均边际贡献,来公平地分配“功劳”(即对预测的影响)。SHAP值提供了局部解释(针对单个样本的预测),并可通过聚合许多局部解释来获得全局洞察。

2.方法原理

SHAP的原理建立在沙普利值的基础上,并满足三个关键属性:

局部准确性:对于特定输入x,所有特征的SHAP值之和等于模型预测值f(x)与基线期望值E[f(z)]的差值。

一致性:如果一个模型的变化使得某个特征在任何情况下的贡献都增加或保持不变,那么该特征的SHAP值不应减少。

缺失性:对模型输出没有影响的特征,其SHAP值为零。

针对树模型的优化(TreeExplainer):对于随机森林、梯度提升树等树集成模型,通用的SHAP计算是NP难的。TreeExplainer算法通过利用树模型的内在结构(如路径覆盖信息),将计算复杂度从指数级降低到多项式级(O(TLD^2),其中 T 为树的数量,L 为最大叶子数,D 为最大深度),从而实现了精确且高效的SHAP值计算。

扩展:SHAP交互值:除了单一特征贡献,SHAP还可以计算特征交互效应(SHAP Interaction Values)。它基于沙普利交互指数,生成一个矩阵,对角线元素代表特征的主效应,非对角线元素代表两两特征之间的交互效应,从而更细致地揭示模型行为。

3.适用数据,输入和输出内容

适用数据:SHAP是模型无关的,理论上适用于任何机器学习模型(如线性模型、树模型、神经网络)所做的预测。在提供的资料中,它被广泛应用于处理结构化表格数据,例如医学数据集(患者特征)、多组学数据(基因、蛋白、甲基化等特征)、影像组学和病理学特征等。

输入:

一个训练好的机器学习模型。

需要解释的样本数据(单个样本或整个数据集)。

(可选)一个背景数据集(通常用训练集),用于估计特征缺失时的条件期望。TreeExplainer也可以直接利用树模型中存储的路径覆盖信息,无需额外提供。

输出:

SHAP值:对于每个样本的每个特征,输出一个数值。正值表示该特征增加了预测值(如死亡风险、疾病进展概率),负值则表示降低了预测值。

SHAP交互值矩阵(可选):输出一个矩阵,量化每对特征之间的局部交互效应。

4.适用分析场景和在其中的作用

SHAP主要用于模型可解释性和决策支持,在以下场景中发挥关键作用:

理解个体预测:医生可以查看具体患者的SHAP值,理解为什么模型给出高风险或低风险的预测(例如,哪些化验指标异常推高了风险),从而辅助临床决策,而非盲目信任“黑箱”。

识别全局重要特征:通过对整个数据集的SHAP值取绝对平均值,可以排序出对模型预测影响最大的特征,比传统的特征重要性(如基尼重要性)更具理论保证且更一致。

可视化特征依赖关系:绘制SHAP依赖图,显示单个特征值(x轴)与其SHAP值(y轴,即对预测的影响)的关系。图中的垂直离散度揭示了该特征与其他特征的交互效应。

检测特征交互:使用SHAP交互值,可以定量识别并可视化重要的特征交互组合(如年龄与性别对死亡风险的联合影响)。

模型监控与调试:通过解释模型的损失函数而非预测值,可以将模型在部署后的性能下降归因于具体的输入特征,从而快速定位数据管道错误、特征漂移或配置问题。

监督式聚类与降维:将每个样本的SHAP值向量作为“解释空间”中的嵌入,进行聚类或PCA。这能将样本按照“相似的风险原因”分组,或发现数据中与结局相关的潜在结构(如血液指标与尿液指标的风险因子分离)。

5.使用该方法的文章示例

《Multimodal radiopathomics approach for predictions of prognosis and immunotherapy response in patients with gastric cancer》:使用SHAP分析来解释结合了放射组学和病理组学特征的预后预测模型。文章展示了前20个重要特征的SHAP贡献图,并比较了放射病理学签名(RPS)与临床病理特征的重要性。

《Multiomic integration reveals subtype-specific predictors of neoadjuvant treatment response in breast cancer》:在基于多组学数据(蛋白、RNA、甲基化等)构建乳腺癌新辅助治疗反应预测模型(使用LightGBM)后,计算SHAP值以评估各特征的重要性,并识别不同亚型中的关键预测因子。

《Electrocardiogram-based deep learning to predict mortality in paediatric and adult congenital heart disease》:使用基于SHAP框架的显著性映射(saliency mapping)来解释基于心电图的深度学习模型,突出显示对预测5年死亡率贡献最大的心电图区域。

《Machine learning in Alzheimer disease genetics》:在使用XGBoost训练梯度提升机(GBM)进行阿尔茨海默病遗传风险预测时,使用SHAP值来评估所有预测因子(SNPs)的重要性,并识别驱动预测的关键遗传变异(如APOE等位基因)。

总之,SHAP是一种基于博弈论沙普利值的模型解释方法,能为任何机器学习模型的预测提供一致且可解释的局部特征重要性度量。

展博科研总经理欧阳恺:“展博科研始终致力于为科研工作者提供专业、高效的科研支持服务。我们将持续优化服务内容,助力研究者。”

展博科研新媒体总监夏练:“未来我们会通过平台分享更多实用干货与服务案例,帮助大家提升科研效率。欢迎关注展博科研官方渠道,获取最新资讯。”

更多内容可关注展博科研公众号矩阵:展博科研目前拥有公众号30+,精准服务几十万专业医疗及科研工作者,其中真实的线上科研答疑视频深受医生及科研群体喜爱,公众号包括展博心域通、展博骨事、展博肾学、展博眼研通、展博麻海、展博消化通、展博脉管通、展博风免通、展博血研通、展博儿研通、展博本草研究、展博呼吸通、展博口研通、展博泌外通、展博脑神通、展博硕博论文、刀锋科研、展博高分课题、展博急重科研、展博妇与产、展博五官通、展博精神通、展博肿瘤通、展博科研创新、国自然设计思路、国自然立项、展博课题申报、展博科研、展博材料通

展博科研简介

展博科研在湖南乃至整个中国都是排名靠前的专业科研机构,目前员工150 人左右,硕博文凭占比 40%,依托国内顶尖高校教授团队,在NATURE MEDICINE(IF:50)、CANCER CELL(IF:44.5)、Nature Cancer(IF:28.5)、Nature Metabolism(IF:20.8)等顶尖期刊协助客户发表文章。

责任编辑:kj005

在日常生活中,单眼近视因隐匿性常被忽视,可能对青少年视觉发育造成潜在威胁案例回顾:单眼视力悬殊引发关注2024年8月,小研(化名)在家长陪同下前往玉林爱尔眼科医...

长时间面对黑板、屏幕和作业本,眼干、酸涩、视物出现重影……教师群体及长期伏案工作者的眼表健康问题正日益受到关注南京某高中一位从教十余...

近日,凭借在眼科诊疗领域的深厚积淀与区域影响力,大理爱尔眼科医院迎来了省外医疗同行的专题参访聚焦前沿技术:飞秒白内障与制瓣技术成学习焦点4月23日,新昌县人民医...